Attention

什么是Attention?

“Dynamic Conditional Generation”意思是动态条件生成,相较于传统的RNN,attention不需要考虑整个句子的信息,只需要考虑到与其关系比较近的词语的信息。

Attentio的工作原理?

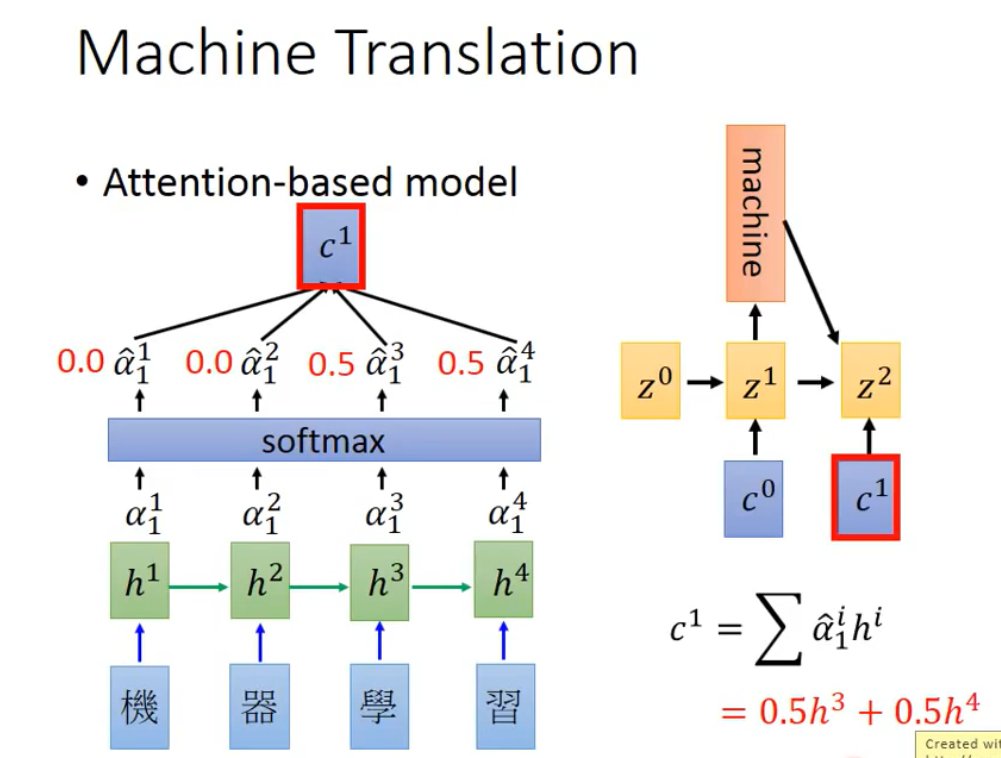

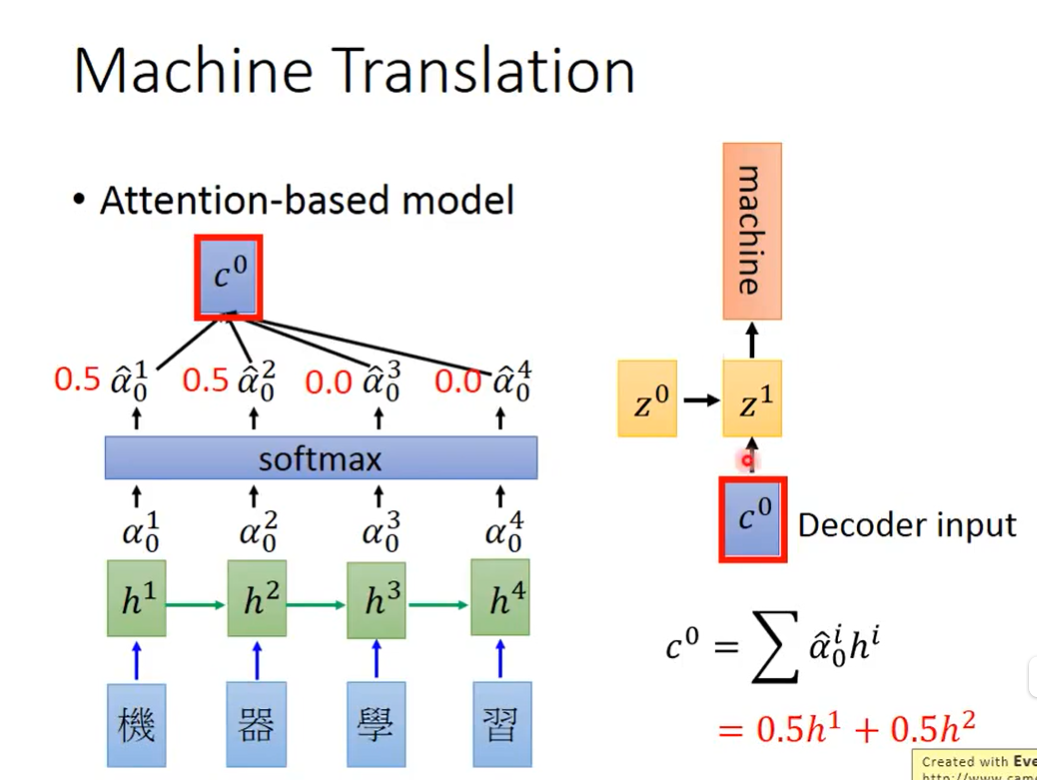

在上图中,输入是”机器学习”,通过rnn的隐含层输出的a后再经过softmax层,输出一个a^,a^再与hi对应的权值相乘再求和得到c0。c0作为decoder input,进行decode,再经过rnn得到machine的输出。在上面的计算过程中,可以看到”学”,”习”对应的h3,h4与h1的”机”的对应关系为0。

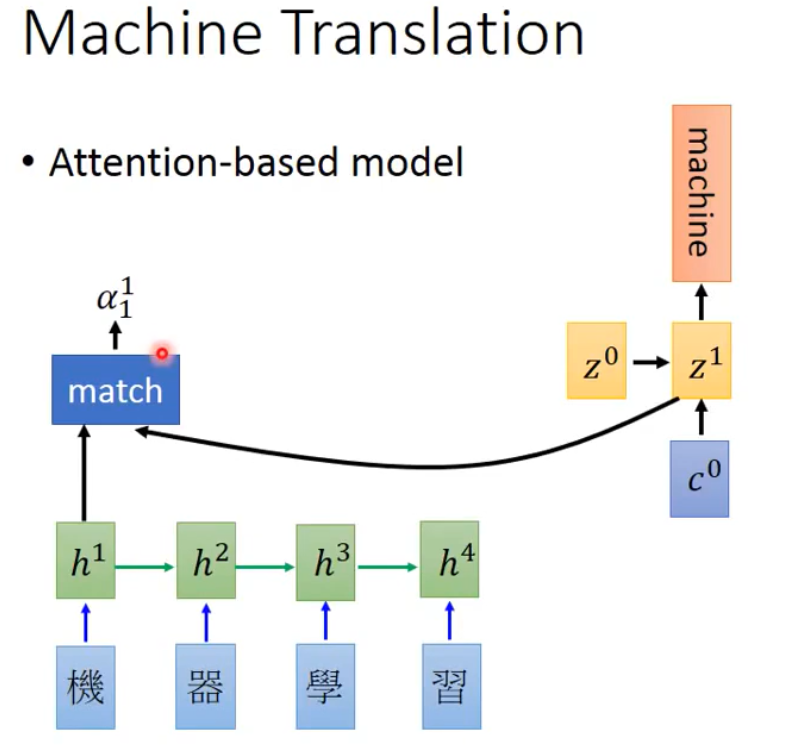

在上图中在z1*h1得到a11的分数,再经过softmax计算得到c1,c1作为新的输入如此重复进行